¿Felices, tristes o enojados? Esta herramienta de Microsoft reconoce las emociones en las fotos

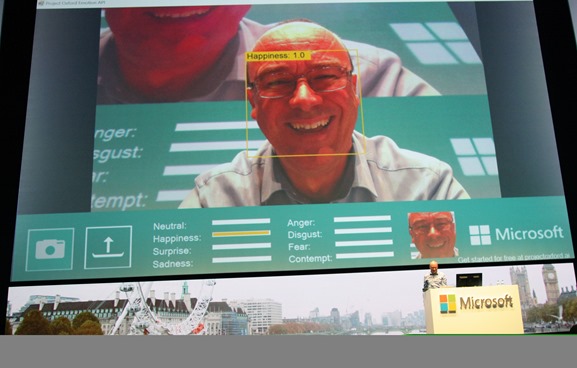

Chris Bishop, director de Microsoft Research en Cambridge, muestra una nueva herramienta que reconoce las emociones de los rostros en las fotos, esto durante la conferencia de Microsoft, ‘Future Decoded’.

De manera tradicional los humanos han sido muy buenos para reconocer las emociones en las caras de las personas, pero, ¿las computadoras? No tanto.

Por lo menos hasta ahora. Recientes avances en el campo del aprendizaje de máquina y de la inteligencia artificial permiten a los científicos en computación crear aplicaciones más inteligentes que puedan identificar cosas como sonidos, palabras, imágenes, e incluso expresiones faciales.

El equipo de Microsoft Project Oxford anunció planes para lanzar versiones públicas de prueba de nuevas herramientas que ayuden a los desarrolladores a tomar ventaja de esas capacidades, que incluyen una que puede reconocer emociones. Chris Bishop, director de Microsoft Research en Cambridge en el Reino Unido, mostró la herramienta de las emociones en una presentación que realizó en Future Decoded, una conferencia de Microsoft acerca del futuro de las empresas y la tecnología.

La herramientas, de las cuales muchas son utilizadas en los propios productos de Microsoft, están diseñadas para desarrolladores quienes no tienen experiencia en el aprendizaje de máquina o en inteligencia artificial; pero quieren incluir capacidades como el discurso, visión y lenguaje de entendimiento dentro de sus aplicaciones.

Microsoft lanzó el primer conjunto de Herramientas Microsoft Project Oxford, la primavera pasada, y los líderes del proyecto dicen que rápido contagiaron interés en todos, desde compañías de la lista Fortune 500, hasta pequeñas empresas y emprendimientos en formación que tienen entusiasmo por este tipo de capacidades, pero que no poseen un “equipo de expertos en aprendizaje de máquina o inteligencia artificial.

“Lo interesante es conocer qué tanto interés hay y las reacciones tan diversas que existen al respecto”, dijo Ryan Galgon, un gerente senior en programación dentro del grupo de Tecnología e Investigación de Microsoft.

Emociones, video, corrección de ortografía y pelo facial

Con ayuda del aprendizaje de máquina, este tipo de sistemas se vuelven más inteligentes conforme reciben más datos; la tecnología es la base para para un mejor avance que incluye las traducciones en tiempo real de Skype Translator y la asistente personal de Microsoft, Cortana.

En el caso de los reconocimientos faciales, el sistema puede aprender a reconocer ciertos rasgos de un conjunto entrenado de imágenes recibidas, y después poder aplicar esa información para identificar características faciales en nuevas imágenes capturadas.

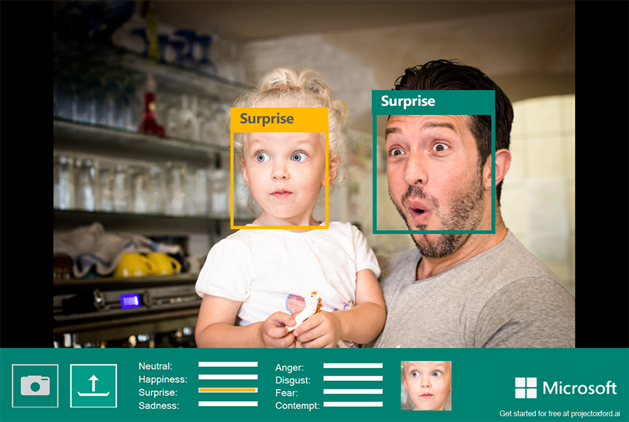

La herramienta de emociones que se presentó recientemente puede usarse para crear sistemas que reconocen ocho estados emocionales, enojo, desprecio, miedo, disgusto, felicidad, neutralidad, tristeza o sorpresa; con base en las expresiones faciales que reflejan esos sentimientos.

Galgon mencionó que tal vez los desarrolladores quieren usar las herramientas para crear sistemas que los expertos en mercadotecnia puedan usar para medir la reacción de las personas ante los aparadores de las tiendas, películas o comida. O tal vez sean valiosos para crear una herramienta de consumo, tales como una aplicación de mensajería, que ofrezca diferentes opciones basadas en la emoción reconocida en la foto.

La tecnología para el reconocimiento facial, que es parte de Microsoft Project Oxford, también puede usarse en muchas otras formas, tales como la agrupación de colecciones de fotos, basadas en las caras de las personas que aparezcan en ellas.

O puede usarse para más propósitos de entretenimiento. A principios de esa semana, en honor al esfuerzo Movember para recaudar fondos gracias al bello facial, Microsoft lanzó MyMoustches, el cual usa la tecnología para reconocer y medir la cantidad de vello facial.

La herramienta de emociones ya está disponible para desarrolladores como versión de prueba. En adición, Microsoft ha comenzó con el lanzamiento de versiones de prueba para otras diversas herramientas para finales de este año. Las herramientas están disponibles por tiempo de prueba limitado.

Estas incluyen:

Corrector de ortografía: Esta herramienta, la cual los desarrolladores pueden agregar a sus aplicaciones en sus dispositivos móviles, en la nube o en otros productos, reconoce palabras de argot como ‘voy a’, y varios nombres de marcas, errores comunes de nombres y errores difíciles de identificar como ‘cuatro’ y ‘para’. También agrega nuevos nombres de marcas y expresiones mientras que son acuñadas y en camino a ser populares. Ya está disponible como versión de prueba pública.

Video: Esta herramienta permite a los clientes analizar de manera sencilla y editar de manera automática con solo hacer cosas como rastreo de rostros, detectar movimientos y estabilizar videos movidos. Está basada en algo de la misma tecnología que funciona en Microsoft Hyperlapse. Estará disponible como prueba a finales de este año.

Reconocimiento de voz: Esta herramienta puede ser usada para reconocer a quien está hablando con base en el aprendizaje de las voces particulares de las personas. Un desarrollador podría usar la voz como medida de seguridad justo como las huellas digitales, las cuales son únicas. Estará disponible como versión de prueba pública a finales de este año.

Reconocimiento personalizado de servicios inteligentes: Esta herramienta, también conocida como CRIS, facilita a las personas el personalizar su reconocimiento de voz, para ambientes que puedan representar un reto, tales como un lugar público donde hay mucho ruido. Por ejemplo, una compañía podría usarla para ayudar a un equipo a utilizar mejor esta herramienta mientras trabajan en un piso de compras ruidoso o un centro comercial. También podría usarse como apoyo en una aplicación para personas que tienen problemas con el reconocimiento de voz, como hablantes no nativos o gente con discapacidad. Estará disponible como versión de prueba, solo con invitación, a finales de este año.

Actualizaciones para el API facial: En adición a las nuevas herramientas, la ya existente herramienta de detección facial de Microsoft Project Oxford, se actualizará para que incluya herramientas para predecir aspectos como el pelo facial y las sonrisas; y la herramienta también mejoró en relación con la estimación visual de la edad y la identificación de género.

Los desarrolladores que estén interesados en estas herramientas pueden descubrir más acerca de ellas y probarlas con solo visitar el sitio web de Microsoft Project Oxford.